Ai chịu trách nhiệm khi trí tuệ nhân tạo sao chép tác phẩm?

Sự bùng nổ của AI tạo sinh (Generative AI) như ChatGPT, Midjourney, hay Stable Diffusion đã đặt ra một thách thức chưa từng có đối với hệ thống pháp luật về Sở hữu trí tuệ (SHTT). Khi một công cụ AI tạo ra một bức tranh y hệt phong cách của một họa sĩ nổi tiếng, hoặc viết ra một đoạn nhạc “đạo” lại tác phẩm đang được bảo hộ, câu hỏi pháp lý hóc búa nhất xuất hiện: Ai là người chịu trách nhiệm bồi thường thiệt hại?

Bài viết này phân tích cơ sở pháp lý để xác định trách nhiệm trong bối cảnh luật pháp Việt Nam hiện hành và tham chiếu xu hướng quốc tế.

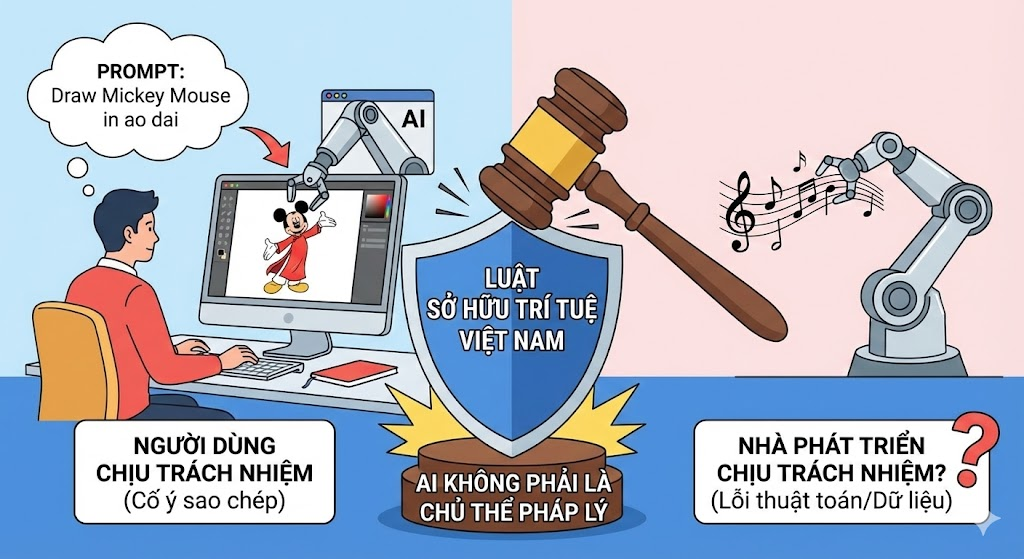

1. Rào cản pháp lý đầu tiên: AI không phải là “Người”

Để xác định ai chịu trách nhiệm, trước hết phải xác định ai có “tư cách pháp lý” để bị kiện.

- Nguyên tắc cơ bản: Theo Bộ luật Dân sự 2015 của Việt Nam, chủ thể của quan hệ pháp luật dân sự chỉ có thể là cá nhân (thể nhân) hoặc pháp nhân (tổ chức/doanh nghiệp).

- Địa vị của AI: Đến thời điểm hiện tại (2025), pháp luật Việt Nam (và hầu hết các quốc gia trên thế giới) không công nhận AI là một chủ thể pháp lý độc lập. AI chỉ được xem là một công cụ, một loại tài sản hoặc phương tiện kỹ thuật do con người tạo ra và vận hành.

Hệ quả: Bạn không thể kiện một phần mềm AI ra tòa, và AI không có tài sản riêng để bồi thường thiệt hại. Trách nhiệm pháp lý bắt buộc phải được truy nguyên về các chủ thể là con người hoặc tổ chức đứng sau công cụ đó.

2. Phân tách hành vi xâm phạm: Đầu vào (Input) và Đầu ra (Output)

Việc AI xâm phạm bản quyền có thể diễn ra ở hai giai đoạn hoàn toàn khác nhau với các chủ thể chịu trách nhiệm khác nhau:

Giai đoạn 1: Xâm phạm ở khâu Huấn luyện (Training Data – Input)

Để AI “thông minh”, nó phải được “học” từ hàng tỷ dữ liệu (ảnh, văn bản, nhạc…) trên internet. Vấn đề là phần lớn dữ liệu này là tác phẩm có bản quyền và được sử dụng mà không xin phép tác giả.

- Hành vi: Sao chép tác phẩm để tạo lập cơ sở dữ liệu huấn luyện AI.

- Đối tượng chịu rủi ro: Các Nhà phát triển (Developers) mô hình AI nền tảng (Ví dụ: OpenAI, Google, Stability AI…).

- Góc nhìn pháp lý Việt Nam: Luật SHTT Việt Nam hiện hành chưa có quy định ngoại lệ rõ ràng cho việc “khai thác văn bản và dữ liệu” (Text and Data Mining – TDM) vì mục đích thương mại. Về mặt lý thuyết, việc sao chép tác phẩm để train AI mà không xin phép là hành vi xâm phạm quyền sao chép (Điều 20 Luật SHTT).

- (Tham chiếu quốc tế: Đây là trọng tâm vụ kiện báo The New York Times kiện OpenAI tại Mỹ).

Giai đoạn 2: Xâm phạm ở khâu Tạo sinh (Generation – Output)

Đây là trường hợp phổ biến hơn đối với người dùng cuối. Khi AI tạo ra một sản phẩm mới (ảnh, bài viết, code) mà sản phẩm đó quá giống với một tác phẩm gốc đang được bảo hộ.

- Hành vi: Tạo ra tác phẩm phái sinh trái phép hoặc sao chép một phần tác phẩm gốc.

- Đối tượng chịu rủi ro: Cả Người sử dụng và Nhà cung cấp công cụ.

3. Xác định trách nhiệm pháp lý: Ai phải bồi thường?

Khi một tác phẩm đầu ra của AI bị cáo buộc xâm phạm bản quyền, việc quy trách nhiệm sẽ dựa trên yếu tố LỖI và mức độ kiểm soát hành vi:

Kịch bản A: Trách nhiệm thuộc về NGƯỜI SỬ DỤNG

Đây là kịch bản dễ xảy ra nhất trong thực tế doanh nghiệp. Người sử dụng sẽ chịu trách nhiệm chính nếu hành vi xâm phạm là kết quả trực tiếp từ mệnh lệnh (prompt) của họ.

- Ví dụ: Một nhân viên thiết kế của công ty A ra lệnh cho AI: “Hãy vẽ lại nhân vật Ironman nhưng mặc áo dài Việt Nam để dùng cho chiến dịch quảng cáo”.

- Phân tích: Nhân vật Ironman đang được bảo hộ bản quyền. Hành vi này là cố ý tạo ra tác phẩm phái sinh mà không xin phép chủ sở hữu (Disney). AI chỉ là công cụ thực hiện ý chí của người dùng.

- Hậu quả: Công ty A (pháp nhân sử dụng lao động) sẽ phải chịu trách nhiệm pháp lý về hành vi xâm phạm SHTT do nhân viên mình gây ra trong quá trình thực hiện nhiệm vụ.

Kịch bản B: Trách nhiệm thuộc về NHÀ PHÁT TRIỂN/CUNG CẤP AI

Nhà phát triển có thể liên đới chịu trách nhiệm nếu họ không thực hiện đủ các biện pháp kỹ thuật hợp lý để ngăn chặn vi phạm.

- Cơ sở: Trách nhiệm sản phẩm hoặc lỗi trong việc thiết kế thuật toán. Nếu AI được huấn luyện quá mức trên một tập dữ liệu hẹp (ví dụ: chỉ học tranh của một họa sĩ duy nhất) khiến nó liên tục tạo ra các tác phẩm sao chép mà không có cơ chế lọc.

- Thực tế: Các nhà phát triển lớn (Big Tech) thường tự bảo vệ mình bằng:

- Điều khoản sử dụng (Terms of Service): Quy định rõ người dùng phải chịu hoàn toàn trách nhiệm về nội dung đầu vào (prompt) và đầu ra (output) do mình tạo ra.

- Biện pháp kỹ thuật: Xây dựng các bộ lọc để từ chối các yêu cầu tạo sinh vi phạm rõ ràng (ví dụ: từ chối vẽ logo các thương hiệu lớn).

Kịch bản C: Trách nhiệm liên đới

Trong nhiều trường hợp, trách nhiệm có thể được chia sẻ. Ví dụ, nếu nhà cung cấp AI quảng cáo rằng công cụ của họ “an toàn tuyệt đối về bản quyền” (gây nhầm lẫn cho người dùng), nhưng thực tế lại không có cơ chế lọc hiệu quả, thì họ có thể bị coi là có lỗi và phải liên đới bồi thường cùng người dùng.

4. Khuyến nghị thực tiễn cho Doanh nghiệp

Để tránh trở thành “nạn nhân” trong các vụ kiện bản quyền liên quan đến AI, doanh nghiệp cần chủ động quản trị rủi ro:

- Nguyên tắc “Human-in-the-loop” (Con người kiểm duyệt): Không bao giờ sử dụng trực tiếp sản phẩm đầu ra của AI cho mục đích thương mại (đăng web, in ấn phẩm, làm logo) mà không qua sự kiểm duyệt của con người.

- Đào tạo nhân viên về “Prompting sạch”: Cấm nhân viên sử dụng các câu lệnh yêu cầu AI sao chép phong cách cụ thể của nghệ sĩ đang còn sống, hoặc sử dụng các nhân vật/thương hiệu đã được bảo hộ trong câu lệnh.

- Sử dụng công cụ rà soát: Đối với các nội dung văn bản hoặc code do AI tạo ra, cần chạy qua các phần mềm kiểm tra đạo văn (plagiarism checker) uy tín trước khi sử dụng.

- Rà soát Điều khoản dịch vụ (ToS): Khi mua bản quyền sử dụng các công cụ AI cho doanh nghiệp (ví dụ: ChatGPT Enterprise, Midjourney gói Pro), cần đọc kỹ điều khoản về trách nhiệm pháp lý và quyền sở hữu đối với dữ liệu đầu ra. Một số gói trả phí cao cấp có cam kết hỗ trợ pháp lý nếu người dùng bị kiện bản quyền (với điều kiện nhất định).

Kết luận

Trong khi chờ đợi các quy định pháp luật cụ thể về AI được ban hành, nguyên tắc “AI là công cụ, con người là chủ thể chịu trách nhiệm” vẫn là kim chỉ nam. Doanh nghiệp sử dụng AI cần nhận thức rõ: Sự tiện lợi của công nghệ đi kèm với rủi ro pháp lý cao, và sự cẩn trọng của con người là “lá chắn” duy nhất hiện nay.

Liên hệ Luật sư tư vấn: Luật TLA là một trong những đơn vị luật sư hàng đầu, với đội ngũ luật sư, cán bộ nhiều kinh nghiệm trong các lĩnh vực hình sự, dân sự, doanh nghiệp, hôn nhân và gia đình,… Chúng tôi sẵn sàng hỗ trợ, giải đáp mọi thắc mắc về pháp lý của bạn. Nếu bạn còn thắc mắc về nội dung này, hãy liên hệ ngay với chúng tôi để được giải đáp thắc mắc.

- Luật sư Vũ Thị Phương Thanh, Giám đốc Công ty Luật TNHH TLA, Đoàn Luật sư Hà Nội,

email: vtpthanh@tlalaw.vn; - Luật sư Trần Mỹ Lê, Chủ tịch HĐTV Công ty Luật TNHH TLA, Đoàn Luật sư Hà Nội;

email: tmle@tlalaw.vn

Địa chỉ: Tầng 7, số 06 Dương Đình Nghệ, Yên Hòa, Cầu Giấy, Hà Nội

Website: https://tlalaw.vn/

Hotline: 0906246464

Nguyễn Hiền Mai